Đăng ký nhận báo giá

Nvidia ra mắt nền tảng AI Vera Rubin, đặt cược lớn vào kỷ nguyên “AI tác nhân”

Thứ hai vừa qua, Nvidia đã công bố Vera Rubin – một nền tảng trí tuệ nhân tạo hoàn toàn mới, tích hợp bảy loại chip và hướng đến việc tái định hình hạ tầng điện toán cho AI thế hệ tiếp theo. Hệ thống này nhận được sự hậu thuẫn từ nhiều tên tuổi lớn như OpenAI, Anthropic, Meta và Mistral AI.

Theo Nvidia, Vera Rubin được thiết kế để đạt hiệu suất suy luận trên mỗi watt cao gấp 10 lần và giảm chi phí trên mỗi token xuống còn một phần mười so với thế hệ trước đó là Blackwell. CEO Jensen Huang gọi đây là “bước nhảy vọt thế hệ” và là nền tảng cho “cơ sở hạ tầng AI lớn nhất trong lịch sử”.

Nền tảng mới sẽ được triển khai trên các hệ sinh thái đám mây lớn như Amazon Web Services, Google Cloud, Microsoft Azure và Oracle Cloud Infrastructure, cùng hơn 80 đối tác phần cứng.

Kiến trúc bảy chip và tham vọng xây dựng “siêu máy tính AI”

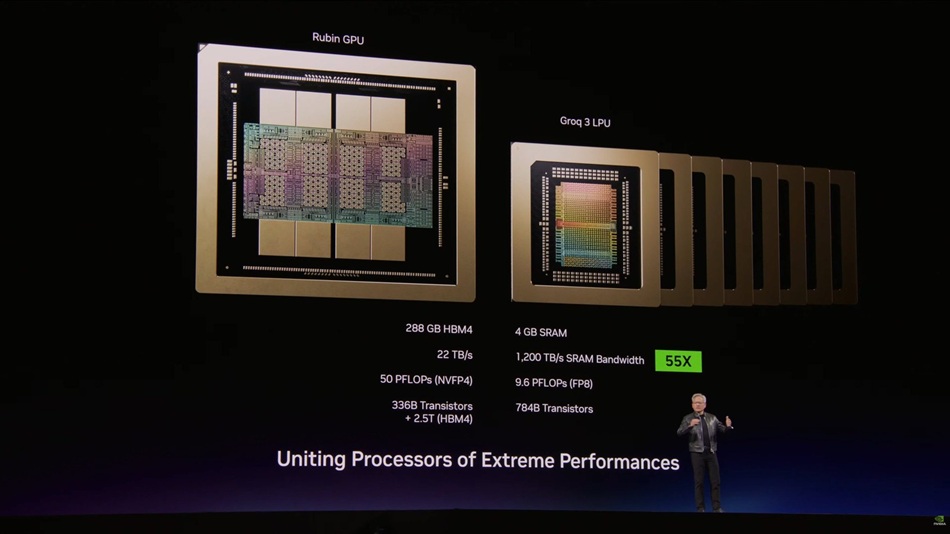

Vera Rubin không chỉ là một con chip đơn lẻ mà là một hệ sinh thái phần cứng tích hợp. Nền tảng này kết hợp CPU Vera, GPU Rubin, NVLink thế hệ mới, DPU BlueField-4, SuperNIC ConnectX-9, hệ thống mạng Spectrum-6 và bộ tăng tốc suy luận Groq 3.

Các thành phần được tổ chức thành nhiều rack có thể kết nối, hoạt động như một siêu máy tính thống nhất. Trong đó, cấu hình NVL72 tích hợp 72 GPU và 36 CPU, cho phép huấn luyện các mô hình lớn với số lượng GPU ít hơn đáng kể so với trước đây.

Điểm đáng chú ý là CPU Vera được thiết kế riêng cho các tác vụ AI tác nhân và học tăng cường, với khả năng xử lý đồng thời hàng chục nghìn môi trường chạy – nơi các hệ thống AI có thể thực thi và kiểm tra mã liên tục.

Sự chuyển dịch sang “AI tác nhân”

Thông điệp chiến lược của Nvidia nằm ở một khái niệm: “AI tác nhân” (agent AI). Khác với chatbot truyền thống chỉ phản hồi theo từng câu lệnh, AI tác nhân có thể hoạt động liên tục, tự lập kế hoạch, thực thi nhiệm vụ và cải tiến theo thời gian.

Sự thay đổi này kéo theo nhu cầu hạ tầng hoàn toàn khác. Nếu chatbot chỉ cần xử lý trong thời gian ngắn, thì AI tác nhân có thể tiêu tốn tài nguyên trong nhiều giờ hoặc nhiều ngày, đòi hỏi sự phối hợp giữa GPU, CPU, bộ nhớ và hệ thống lưu trữ ở quy mô lớn.

Để hỗ trợ xu hướng này, Nvidia ra mắt bộ công cụ Agent Toolkit và môi trường OpenShell nhằm tăng cường bảo mật và khả năng vận hành cho các hệ thống AI tự động. Đồng thời, phần mềm Dynamo 1.0 được giới thiệu như một “hệ điều hành” cho suy luận AI quy mô lớn.

Mở rộng hệ sinh thái phần mềm và mô hình mở

Song song với phần cứng, Nvidia cũng đẩy mạnh chiến lược phần mềm thông qua liên minh Nemotron. Đây là sự hợp tác giữa nhiều tổ chức nhằm phát triển các mô hình AI mã nguồn mở trên nền tảng DGX Cloud.

Các mô hình mới như Nemotron 3 Ultra, Omni hay VoiceChat được thiết kế để xử lý đa phương thức, từ văn bản đến hình ảnh và âm thanh. Ngoài ra, Nvidia còn giới thiệu GR00T N2 – mô hình nền tảng cho robot, hướng đến các ứng dụng trong môi trường thực tế.

Chiến lược mô hình mở giúp Nvidia thu hút cộng đồng phát triển, đồng thời duy trì vai trò là nhà cung cấp nền tảng thay vì đối thủ trực tiếp của các công ty AI.

Ứng dụng trải rộng từ y tế đến xe tự lái và không gian

Các công bố tại GTC cho thấy phạm vi ứng dụng ngày càng rộng của hạ tầng AI. Trong lĩnh vực y tế, Roche triển khai hàng nghìn GPU để phục vụ nghiên cứu dược phẩm. Trong ngành ô tô, các hãng như BYD và Nissan sử dụng nền tảng của Nvidia cho xe tự lái.

Ở lĩnh vực robot y tế, Nvidia hợp tác với Johnson & Johnson MedTech và Medtronic để phát triển hệ thống AI hỗ trợ phẫu thuật.

Đáng chú ý, công ty còn giới thiệu nền tảng tính toán cho không gian, cho phép xử lý AI trực tiếp trên quỹ đạo với hiệu năng cao hơn nhiều so với thế hệ trước.

Đưa AI xuống máy tính cá nhân

Bên cạnh hạ tầng trung tâm dữ liệu, Nvidia cũng ra mắt DGX Station – hệ thống máy trạm có thể chạy các mô hình AI quy mô lớn ngay tại chỗ. Thiết bị này cho phép các tổ chức nghiên cứu và doanh nghiệp triển khai AI mà không phụ thuộc hoàn toàn vào đám mây.

Các tổ chức như Microsoft Research và một số trường đại học đã bắt đầu thử nghiệm hệ thống này, cho thấy xu hướng “cá nhân hóa” hạ tầng AI.

Tầm nhìn “nhà máy AI” và những câu hỏi còn bỏ ngỏ

Một trong những điểm đáng chú ý là thiết kế tham chiếu “AI Factory” – mô hình trung tâm dữ liệu được tối ưu hóa để sản xuất AI ở quy mô công nghiệp. Nvidia coi token AI là “đơn vị giá trị mới”, còn các trung tâm dữ liệu là “nhà máy sản xuất trí tuệ”.

Tuy nhiên, không phải tất cả đều đã được kiểm chứng. Các tuyên bố về hiệu năng của Vera Rubin vẫn cần đánh giá độc lập. Đồng thời, chiến lược đặt cược vào AI tác nhân vẫn phụ thuộc vào việc mô hình này có thực sự trở thành xu hướng chủ đạo hay không.

Bên cạnh đó, Nvidia cũng đối mặt với cạnh tranh ngày càng tăng từ AMD, các TPU của Google hay chip Trainium của Amazon.

Theo dõi VR360 để nhận những thông tin công nghệ mới nhất.

Bài viết cùng chủ đề

Meta ra mắt mô hình AI mới Muse Spark, cạnh tranh trực tiếp với OpenAI và Anthropic

14/04/2026

14/04/2026 Jensen Huang tuyên bố “Chúng ta đã đạt được AGI”, giới chuyên gia vẫn tranh cãi

03/04/2026

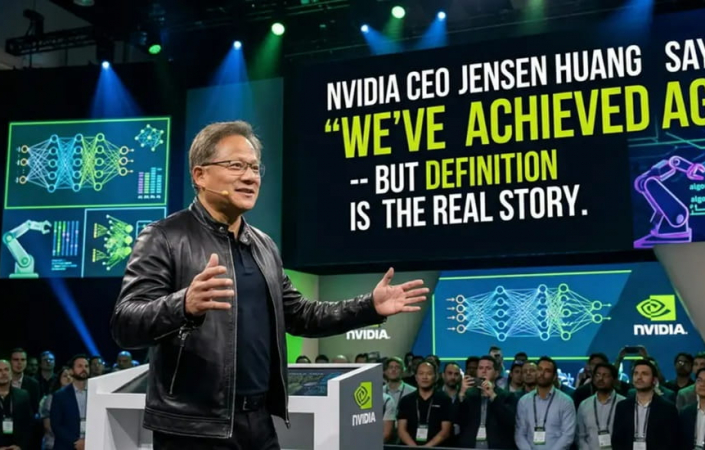

03/04/2026 Meta VR Games Showcase 2026: Bùng nổ 20 tựa game và cập nhật lớn cho hệ sinh thái VR

27/03/2026

27/03/2026 Khám phá CirculaFloor: Tương lai của khả năng di chuyển trong VR

24/02/2026

24/02/2026 Tin tức nhanh: Tổng hợp các nội dung quan trọng tại CES 2026

16/01/2026

16/01/2026 Samsung XR tỏa sáng tại CES 2026: Tương lai XR gắn với AI đã bắt đầu

16/01/2026

16/01/2026 Apple bắt tay Google Gemini để nâng cấp Siri bằng trí tuệ nhân tạo

14/01/2026

14/01/2026 Meta dừng chương trình Horizon OS với các hãng Asus và Lenovo

22/12/2025

22/12/2025 Volkswagen ra mắt chiến dịch quảng cáo ngoài trời ứng dụng Mixed Reality tại Paris

17/12/2025

17/12/2025